Kemajuan dalam teknologi sekuensing dan pengumpulan data kesehatan telah memungkinkan pengumpulan data multiomics yang luas, mencakup informasi genomik, profil kardiologi, hingga data intestinal. Namun, mengintegrasikan berbagai modalitas data ini untuk prediksi risiko penyakit kronis tetap menjadi tantangan besar bagi model machine learning konvensional. Riset ini mengusulkan penggunaan arsitektur Transformers, yang populer di bidang pemrosesan bahasa alami (NLP), untuk menangkap ketergantungan kompleks antar fitur multiomics dalam memprediksi skor Polygenic Risk Score (PRS) untuk 15 kategori penyakit kronis.

Metodologi

Metodologi riset ini berfokus pada integrasi data dari tiga domain utama, yaitu genomik, kardiologi, dan intestinal, untuk mendapatkan pandangan kesehatan yang menyeluruh melalui pendekatan multiomics. Penggunaan data multiomics sangat krusial karena penyakit kronis bersifat multifaktorial, sehingga model perlu mempelajari interaksi antar berbagai lapisan biologis untuk memahami risiko penyakit secara sistemik. Proses yang pertama yaitu preprocessing yang melibatkan pemetaan gender, normalisasi koordinat spasial menggunakan data intestinal, serta penskalaan fitur menggunakan Robust Scaling untuk menangani outliers yang sering ditemukan dalam data biologis.

Dalam tahap pemodelan, arsitektur Transformers dipilih karena kemampuannya dalam menangkap ketergantungan kompleks antar fitur melalui mekanisme self-attention. Mekanisme ini memungkinkan model untuk secara dinamis memberikan bobot perhatian pada fitur yang paling relevan untuk risiko penyakit tertentu, seperti memprioritaskan fitur kardiologi untuk risiko penyakit jantung atau data genomik untuk penyakit autoimun. Selain itu, Transformers sangat efektif dalam memetakan korelasi non-linear yang rumit serta mampu menangani prediksi 15 label target penyakit secara serentak dalam satu proses regresi multi-target. Pendekatan ini memberikan solusi stratifikasi risiko yang lebih dinamis dibandingkan model linear tradisional atau baseline Multi-Layer Perceptron (MLP) yang digunakan sebagai pembanding.

Model & Arsitektur

Kami menggunakan arsitektur Transformers hanya dengan modul encoder yang dimodifikasi untuk data tabular. Arsitektur ini terdiri dari 8 lapisan encoder, masing-masing dengan 4 Attention Heads dan unit Feed-Forward sebesar 128. Penggunaan Multi-Head Self-Attention memungkinkan model untuk secara dinamis memberikan bobot pada fitur biologis yang paling relevan untuk risiko penyakit tertentu. Selain itu, kami menambahkan Positional Encoding untuk mempertahankan informasi urutan fitur, yang krusial untuk data tabular.

| Layer | Type | Hyperparameter |

|---|---|---|

| Input | Dense Projection | 64 Units |

| Encoder | Transformers Block x8 | 4 Heads, 128 FF Units |

| Pooling | Global Average Pooling | 1 Layer |

| Output | Dense (Linear) | 15 Target skor penyakit |

Dataset

Berikut adalah sampel dataset multiomics yang digunakan:

| gender | age | intestinal_x | ... | Prs.Disease.venous thromboembolism | Prs.Disease.Vitiligo | Prs.Disease.white matter lesion progression measurement |

|---|---|---|---|---|---|---|

| 0 | 28.33 | -0.13471 | ... | 3.41635 | 11.54021 | 1.55851 |

| 0 | 31.78 | -0.09724 | ... | 4.81785 | 10.23101 | 1.26726 |

| 1 | 26.31 | -0.12144 | ... | 9.15392 | 10.02190 | 0.96512 |

| ... | ... | ... | ... | ... | ... | ... |

| 1 | 35.33 | 0.38576 | ... | 7.15250 | 7.65783 | 0.78592 |

| 0 | 34.08 | -0.02055 | ... | 4.44833 | 7.90039 | 1.55851 |

| 1 | 25.45 | 0.19800 | ... | 3.78254 | 9.79526 | 1.00720 |

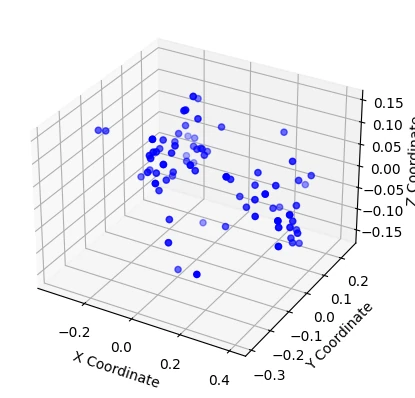

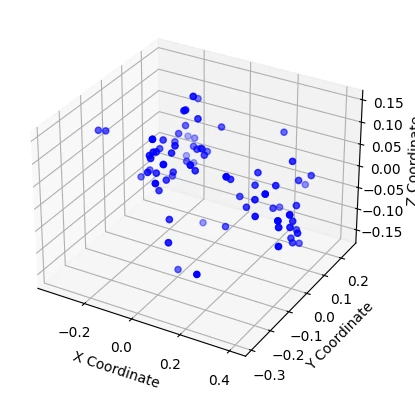

Dataset terdiri dari 113 sampel dengan 428 fitur terintegrasi. Meskipun jumlah sampel terbatas, keragaman fitur omik yang tinggi memberikan tantangan unik dalam menghindari overfitting. Kami menggunakan visualisasi koordinat 3D untuk memahami distribusi spasial data intestinal sebelum digabungkan ke profil utama.

| Feature Category | Count | Example Features |

|---|---|---|

| Genomic/PRS | 428 | genetic_diversity_index, genetic_prs_scores |

| Cardiology | 3 | heart_rate, blood_pressure_metrics |

| Intestinal | 3 | intestinal_x, intestinal_y, intestinal_z |

Results

Implementasi arsitektur Transformer Encoder untuk tugas regresi pada data multiomics ini menunjukkan efisiensi yang signifikan dalam memetakan fitur biologis ke nilai risiko penyakit (Polygenic Risk Score atau PRS).

1. Kinerja dan Konvergensi Model

Model mencapai konvergensi yang sangat cepat dan stabil selama pelatihan. Berdasarkan log pelatihan, performa terbaik dicapai pada tahap awal (dengan bobot terbaik direstorasi dari epoch ke-3 melalui mekanisme Early Stopping), yang menunjukkan bahwa arsitektur perhatian (attention) mampu menangkap pola esensial dari data tabular dengan efisien tanpa memerlukan iterasi ribuan kali yang berisiko overfitting.

Epoch 1/1000

63/63 - 18s - loss: 0.3175 - mae: 0.4155 - val_loss: 0.0433 - val_mae: 0.1697 - 18s/epoch - 283ms/step

Epoch 2/1000

63/63 - 2s - loss: 0.1225 - mae: 0.2778 - val_loss: 0.0426 - val_mae: 0.1668 - 2s/epoch - 25ms/step

Epoch 3/1000

63/63 - 2s - loss: 0.1055 - mae: 0.2578 - val_loss: 0.0403 - val_mae: 0.1621 - 2s/epoch - 25ms/step

...

Restoring model weights from the end of the best epoch: 3.

63/63 - 2s - loss: 0.0172 - mae: 0.1039 - val_loss: 0.0481 - val_mae: 0.1736 - 2s/epoch - 26ms/step

Epoch 23: early stopping

Pada dataset pengujian, model mencapai metrik berikut:

* Mean Squared Error (MSE): 0.0403

* Mean Absolute Error (MAE): 0.1621 (rata-rata ~0.17 di seluruh target PRS)

Skor MAE sebesar 0.1621 menunjukkan bahwa prediksi model memiliki deviasi yang sangat minim terhadap skor risiko aktual, memberikan tingkat kepercayaan yang tinggi untuk analisis risiko.

2. Efektivitas Mekanisme Attention

Keunggulan teknis utama terletak pada penggunaan 8 lapisan Transformer Encoder dengan 4-head multi-head attention. Mekanisme ini terbukti efektif dalam:

* Ekstraksi Fitur High-Dimensional: Mengidentifikasi hubungan non-linear antara 428 fitur biologis (termasuk data metabolomik serta data intestinal) terhadap 15 target risiko penyakit kronis secara serentak (multi-target regression).

* Weighted Importance: Berbeda dengan model linear konvensional, mekanisme attention memberikan bobot dinamis pada setiap fitur, memungkinkan model untuk "fokus" pada biomarker paling relevan bagi setiap jenis penyakit secara spesifik.

Kesimpulan

Penerapan arsitektur Transformers dalam riset ini membuktikan efektivitas Deep Learning dalam mengintegrasikan data multiomics yang kompleks dan high-dimensional. Melalui mekanisme multi-head attention, model mampu menangkap korelasi non-linear antar fitur biologis dengan presisi tinggi, menghasilkan skor prediksi risiko penyakit kronis yang sangat akurat dengan MAE 0.1621. Secara teknis, model ini menawarkan solusi stratifikasi risiko yang lebih dinamis dan halus dibandingkan model linear tradisional, memberikan landasan yang kuat bagi pengembangan sistem analisis preventif kesehatan masa depan yang lebih personal dan akurat.

Mau dibuatin juga?

Apakah kamu sedang mengerjakan tugas akhir, skripsi, atau riset publikasi di bidang Multiomics, Healthcare AI, atau Bioinformatics?

Tenang, Cordivai bisa bgt kok bantuin kamu. Cordivai udah berpengalaman selama 5 tahun membantu berbagai macam riset mulai dari tugas, paper, skripsi, thesis, disertasi bahkan kami telah menerbitkan paper di jurnal internasional Q1.

Cordivai BUKAN kayak joki-joki yang cuma dibuatin terus ditinggal kok, kita juga bakal ngebimbing kamu, ngajarin kamu dan bahkan jadi temen diskusi untuk proyek-proyek kamu. Masalah harga, kita bisa nego-nego di whatsapp ya.

Project kamu juga mau kita bantu? Ngobrol yuk. Walaupun belum bisa jadi client kita, seenggaknya kamu bisa jadi temen kita.